Um zu steuern, welche Seiten von Google und anderen Suchmaschinen gecrawlt und indexiert werden sollen, kann man die robots.txt-Datei und das Meta Robots-Attribut verwenden. Vielen Webmastern ist aber unklar, wann sie welches Instrument einsetzen sollten. Um das zu verstehen, muss vor allem die Funktionsweise der Suchmaschinen bekannt sein.

Um zu steuern, welche Seiten von Google und anderen Suchmaschinen gecrawlt und indexiert werden sollen, kann man die robots.txt-Datei und das Meta Robots-Attribut verwenden. Vielen Webmastern ist aber unklar, wann sie welches Instrument einsetzen sollten. Um das zu verstehen, muss vor allem die Funktionsweise der Suchmaschinen bekannt sein.

Lighthouse ist ein Tool, mit dem man die Performance und die Nutzerfreundlichkeit von Progressive Web Apps testen kann. Aber auch herkömmliche Webseiten kann man damit einer genaueren Betrachtung unterziehen. Der größte Vorteil von Lighthouse gegenüber vielen anderen Tools für die Performancemessung liegt in den flexibel anpassbaren und damit realistischeren Testbedingungen.

Lighthouse ist ein Tool, mit dem man die Performance und die Nutzerfreundlichkeit von Progressive Web Apps testen kann. Aber auch herkömmliche Webseiten kann man damit einer genaueren Betrachtung unterziehen. Der größte Vorteil von Lighthouse gegenüber vielen anderen Tools für die Performancemessung liegt in den flexibel anpassbaren und damit realistischeren Testbedingungen. Mit einer einzigen Codezeile kann man die Adresszeile des Browsers in einer beliebigen Farbe darstellen. Dadurch lässt sich das Aussehen der eigenen Webseite im Browser deutlich aufwerten.

Mit einer einzigen Codezeile kann man die Adresszeile des Browsers in einer beliebigen Farbe darstellen. Dadurch lässt sich das Aussehen der eigenen Webseite im Browser deutlich aufwerten. Der Umzug von Webseiten wie zum Beispiel der Wechsel der Domain stellt immer eine Herausforderung dar. Fehler können zu Rankingverlusten in den Suchergebnissen oder sogar zum Verschwinden von Seiten aus dem Index führen. Daher kommt es auf eine gute Planung und die richtige Reihenfolge der Migrationsschritte an.

Der Umzug von Webseiten wie zum Beispiel der Wechsel der Domain stellt immer eine Herausforderung dar. Fehler können zu Rankingverlusten in den Suchergebnissen oder sogar zum Verschwinden von Seiten aus dem Index führen. Daher kommt es auf eine gute Planung und die richtige Reihenfolge der Migrationsschritte an. Eines der wichtigsten Werkzeuge für SEOs ist die Google Search Console, denn sie liefert Daten aus erster Hand: Empfehlungen, die direkt von Google kommen, sind die wertvollsten Informationen für Webmaster. Zwei Nachteile hat die Google Search Console aber derzeit noch: Daten lassen sich nur für die letzten 90 Tage abrufen, und die Analyse der Daten ist nicht sehr benutzerfreundlich. Ein neues Tool mit dem Namen Search Console Helper verspricht hier Abhilfe.

Eines der wichtigsten Werkzeuge für SEOs ist die Google Search Console, denn sie liefert Daten aus erster Hand: Empfehlungen, die direkt von Google kommen, sind die wertvollsten Informationen für Webmaster. Zwei Nachteile hat die Google Search Console aber derzeit noch: Daten lassen sich nur für die letzten 90 Tage abrufen, und die Analyse der Daten ist nicht sehr benutzerfreundlich. Ein neues Tool mit dem Namen Search Console Helper verspricht hier Abhilfe. Die .htaccess-Datei ist ein mächtiges und gleichzeitig einfach zu bedienendes Werkzeug zur Steuerung von Webservern. Mit wenigen Zeilen Code lassen sich große Effekte erzielen. Einge der nützlichsten Einstellungen werden hier beschrieben.

Die .htaccess-Datei ist ein mächtiges und gleichzeitig einfach zu bedienendes Werkzeug zur Steuerung von Webservern. Mit wenigen Zeilen Code lassen sich große Effekte erzielen. Einge der nützlichsten Einstellungen werden hier beschrieben. Die interne Verlinkung von Webseiten spielt eine bedeutende Rolle für das Ranking in Google und anderen Suchmaschinen. Es kommt darauf an, die wichtigsten Seiten durch eine entsprechende Verlinkung mit Hilfe einer geeigneten Navigationsstruktur und zusätzlicher Verweise zu unterstützen. Der interne PageRank ist in diesem Zusammenhang eine wichtige und sehr oft unterschätzte SEO-Kennzahl. Die Analyse dieser Kennzahl ist mit Hilfe zweier Tools recht einfach durchzuführen. Die Ergebnisse können interessante Überraschungen bereithalten.

Die interne Verlinkung von Webseiten spielt eine bedeutende Rolle für das Ranking in Google und anderen Suchmaschinen. Es kommt darauf an, die wichtigsten Seiten durch eine entsprechende Verlinkung mit Hilfe einer geeigneten Navigationsstruktur und zusätzlicher Verweise zu unterstützen. Der interne PageRank ist in diesem Zusammenhang eine wichtige und sehr oft unterschätzte SEO-Kennzahl. Die Analyse dieser Kennzahl ist mit Hilfe zweier Tools recht einfach durchzuführen. Die Ergebnisse können interessante Überraschungen bereithalten. Das Thema AMP beschäftigt die Webmaster zur Zeit wie kaum ein anderes. Das liegt natürlich vor allem daran, dass Google das Framework fördert und bei jeder sich bietenden Gelegenheit auf dessen Vorteile hinweist. Viele Pioniere der ersten Stunde haben bereits Plugins zur Unterstützung von AMP installiert, stoßen jedoch auf Probleme bei der Validierung. Die folgenden Tipps können dabei helfen, die eigenen AMP-Seiten fit zu machen.

Das Thema AMP beschäftigt die Webmaster zur Zeit wie kaum ein anderes. Das liegt natürlich vor allem daran, dass Google das Framework fördert und bei jeder sich bietenden Gelegenheit auf dessen Vorteile hinweist. Viele Pioniere der ersten Stunde haben bereits Plugins zur Unterstützung von AMP installiert, stoßen jedoch auf Probleme bei der Validierung. Die folgenden Tipps können dabei helfen, die eigenen AMP-Seiten fit zu machen.  Für mehrsprachige Webseiten kann man mit dem x-default-Wert anzeigen, welche Version als Standard gilt, wenn es keine besser geeignete Sprach- oder Regionalversion gibt.

Für mehrsprachige Webseiten kann man mit dem x-default-Wert anzeigen, welche Version als Standard gilt, wenn es keine besser geeignete Sprach- oder Regionalversion gibt. Gerade hat Google viele Webmaster angeschrieben und sie darauf hingewiesen, dass bestimmte Javascript- und CSS-Dateien nicht gecrawlt werden können. Als Folge droht im schlimmsten Fall eine Herabstufung des Rankings. So löst Ihr bestehende Blockaden schnell auf.

Gerade hat Google viele Webmaster angeschrieben und sie darauf hingewiesen, dass bestimmte Javascript- und CSS-Dateien nicht gecrawlt werden können. Als Folge droht im schlimmsten Fall eine Herabstufung des Rankings. So löst Ihr bestehende Blockaden schnell auf. Der, die, das, wer, wie was...Es war schon immer eine gute Idee, die richtigen Fragen zu stellen, wenn man etwas lernen wollte. Was für Kinder gilt, ist auch für SEOs eine gute Empfehlung, denn nur wer weiß, was die Kunden interessiert und wie sie nach Informationen suchen, der kann auch die passenden Antworten liefern. Beim Stellen der richtigen Fragen hilft ab jetzt ein neues Werkzeug: das W-Fragen-Tool.

Der, die, das, wer, wie was...Es war schon immer eine gute Idee, die richtigen Fragen zu stellen, wenn man etwas lernen wollte. Was für Kinder gilt, ist auch für SEOs eine gute Empfehlung, denn nur wer weiß, was die Kunden interessiert und wie sie nach Informationen suchen, der kann auch die passenden Antworten liefern. Beim Stellen der richtigen Fragen hilft ab jetzt ein neues Werkzeug: das W-Fragen-Tool. Für viele kleine Webseiten, die es aus eigener Kraft nicht schaffen, unter die Top-10 bei Google zu kommen, bietet sich das Bewertungsportal Yelp als Alternative an. Wer es schafft, dort genügend Bewertungen zu sammeln, kann dadurch auch bei Google ganz vorne erscheinen.

Für viele kleine Webseiten, die es aus eigener Kraft nicht schaffen, unter die Top-10 bei Google zu kommen, bietet sich das Bewertungsportal Yelp als Alternative an. Wer es schafft, dort genügend Bewertungen zu sammeln, kann dadurch auch bei Google ganz vorne erscheinen. Die Social-News-Plattform Reddit erlaubt den Aufbau von guten Backlinks - wenn man sich an bestimmte und einfache Regeln hält. Dann jedoch winken nicht nur weitere Links, sondern auch zusätzlicher Traffic.

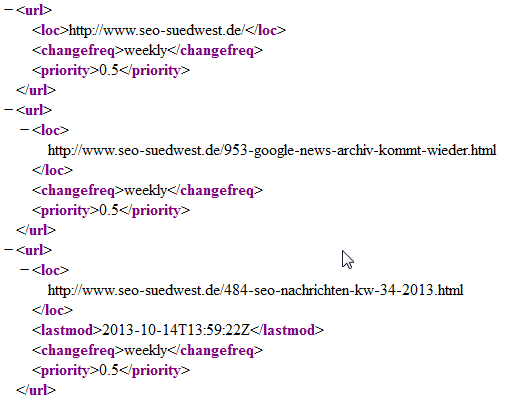

Die Social-News-Plattform Reddit erlaubt den Aufbau von guten Backlinks - wenn man sich an bestimmte und einfache Regeln hält. Dann jedoch winken nicht nur weitere Links, sondern auch zusätzlicher Traffic. Im Rahmen eines Webmaster-Hangouts ging es um die Frage, wie man den Indexierungsstand von Webseiten kontrollieren kann. John Mueller empfiehlt, Sitemaps zu diesem Zweck am besten in logische Einheiten aufzuteilen.

Im Rahmen eines Webmaster-Hangouts ging es um die Frage, wie man den Indexierungsstand von Webseiten kontrollieren kann. John Mueller empfiehlt, Sitemaps zu diesem Zweck am besten in logische Einheiten aufzuteilen. Canonical Links können für Suchmaschinen und SEOs sehr hilfreich sein. Per Canonical lässt sich bestimmen, welche von mehreren möglichen URLs einer Seite die wichtigste ist, die indexiert werden soll. Auf diese Weise lassen sich Probleme mit Duplicate Content (mehrfach indexierten Inhalten) vermeiden. Aber Vorsicht: Wer nicht aufpasst, kann mit dem falschen Einsatz von Canonicals großen Schaden anrichten. Nachfolgend sind 13 der größten Fehler aufgeführt, die man im Umgang mit Canonicals auf jeden Fall vermeiden sollte.

Canonical Links können für Suchmaschinen und SEOs sehr hilfreich sein. Per Canonical lässt sich bestimmen, welche von mehreren möglichen URLs einer Seite die wichtigste ist, die indexiert werden soll. Auf diese Weise lassen sich Probleme mit Duplicate Content (mehrfach indexierten Inhalten) vermeiden. Aber Vorsicht: Wer nicht aufpasst, kann mit dem falschen Einsatz von Canonicals großen Schaden anrichten. Nachfolgend sind 13 der größten Fehler aufgeführt, die man im Umgang mit Canonicals auf jeden Fall vermeiden sollte. Eine gelungene Description kann zu einem besseren Ranking einer Webseite führen. Dabei kommt es vor allem auf die richtige Formulierung und das Ausnutzen des verfügbaren Platzes an.

Eine gelungene Description kann zu einem besseren Ranking einer Webseite führen. Dabei kommt es vor allem auf die richtige Formulierung und das Ausnutzen des verfügbaren Platzes an. YouTube-Videos lassen sich normalerweise nur mit festen Größenangaben einbetten. Das kann auf Webseiten mit Responsive Design zu einer unschönen Darstellung führen. Mit dem folgenden Trick klappt eine Einbindung für YouTube-Videos mit variabler Größe.

YouTube-Videos lassen sich normalerweise nur mit festen Größenangaben einbetten. Das kann auf Webseiten mit Responsive Design zu einer unschönen Darstellung führen. Mit dem folgenden Trick klappt eine Einbindung für YouTube-Videos mit variabler Größe. Kontaktdaten gehören zu den wichtigsten Inhalten von Unternehmenswebseiten, denn sie sorgen dafür, dass potentielle Kunden die Anbieter erreichen können. Gleichzeitig sind diese Kontaktinformationen eine Möglichkeit, eine noch prominentere Darstellung in den Suchergebnissen zu erreichen. Google gibt nun Tipps, wie Telefonnummern und weitere Angaben per schema.org gekennzeichnet werden können.

Kontaktdaten gehören zu den wichtigsten Inhalten von Unternehmenswebseiten, denn sie sorgen dafür, dass potentielle Kunden die Anbieter erreichen können. Gleichzeitig sind diese Kontaktinformationen eine Möglichkeit, eine noch prominentere Darstellung in den Suchergebnissen zu erreichen. Google gibt nun Tipps, wie Telefonnummern und weitere Angaben per schema.org gekennzeichnet werden können. Webseiten aus dem Bildungssektor verfügen oft über die Top-Level-Domain .edu. Solche Webseiten und damit auch Backlinks von ihnen genießen normalerweise eine hohe Reputation und sind gefragt. Hier gibt es sieben Tipps, wie man an solche Links kommen kann.

Webseiten aus dem Bildungssektor verfügen oft über die Top-Level-Domain .edu. Solche Webseiten und damit auch Backlinks von ihnen genießen normalerweise eine hohe Reputation und sind gefragt. Hier gibt es sieben Tipps, wie man an solche Links kommen kann. JComments, eine der beliebtesten Kommentar-Erweiterungen für das Content Management System Joomla, verfügt von Haus aus über ein Captcha, um ungewünschten Spam zu vermeiden. Viele möchten jedoch lieber das von Google bereitgestellte ReCaptcha nutzen. Welche Änderungen dazu am Code von JComments notwendig sind, lest Ihr hier.

JComments, eine der beliebtesten Kommentar-Erweiterungen für das Content Management System Joomla, verfügt von Haus aus über ein Captcha, um ungewünschten Spam zu vermeiden. Viele möchten jedoch lieber das von Google bereitgestellte ReCaptcha nutzen. Welche Änderungen dazu am Code von JComments notwendig sind, lest Ihr hier.

Das Stuttgarter SEO-Unternehmen seonative GmbH bietet mit seinem Produkt sitefactor ein umfassendes SEO-Werkzeug an, mit dem anspruchsvolle Analysen durchgeführt werden können. Neu gestaltet wurde insbesondere das Backlinktool zur Analyse der Verlinkung von Webseiten, welches jetzt mit Daten von eigenen Crawlern arbeitet. Sitefactor kann 30 Tage kostenlos getestet werden. Was genau bietet das Tool, und lohnt sich eine nähere Betrachtung?

Das Stuttgarter SEO-Unternehmen seonative GmbH bietet mit seinem Produkt sitefactor ein umfassendes SEO-Werkzeug an, mit dem anspruchsvolle Analysen durchgeführt werden können. Neu gestaltet wurde insbesondere das Backlinktool zur Analyse der Verlinkung von Webseiten, welches jetzt mit Daten von eigenen Crawlern arbeitet. Sitefactor kann 30 Tage kostenlos getestet werden. Was genau bietet das Tool, und lohnt sich eine nähere Betrachtung?